众所周知,SEO优化中robots机器人是用来抓取网站内容的,而robots.txt文件则是放在我们网站根目录下面的一个文本文件,用来规定什么蜘蛛(机器人)可以抓取什么文件,不可以抓取什么文件。我们通常用robots来告诉搜索引擎,这个目录你可以进,那个目录你不可以进;这个文件你可以访问,那个文件你不能访问。但是有些时候,robots文件,我们还是要谨慎使用的好。

事情还得从年初开始。年初我负责的一个网站因为网站刚建好,内容还没填充完整,大家的观点不都是没建好的网站不要给搜索引擎抓取嘛。我用robots.txt文件把网站根目录屏蔽所有搜索引擎抓取,等到一个月之后,填充得已经差不多了,我就开放蜘蛛抓取。我不仅有提交首页网址给百度,提交网址诊断,而且还发了不少外链,但一天一天过去,在百度上面SITE网站就是一个收录都没有。我就纳闷了,是不是我什么地方设置错误了呢?结果在谷歌上面site了一下已经有上百个收录了,306,搜狗上面也有少则几个多则十几个收录了。于是我不得不认为是robots屏蔽,百度长时间未反应过来导致的。

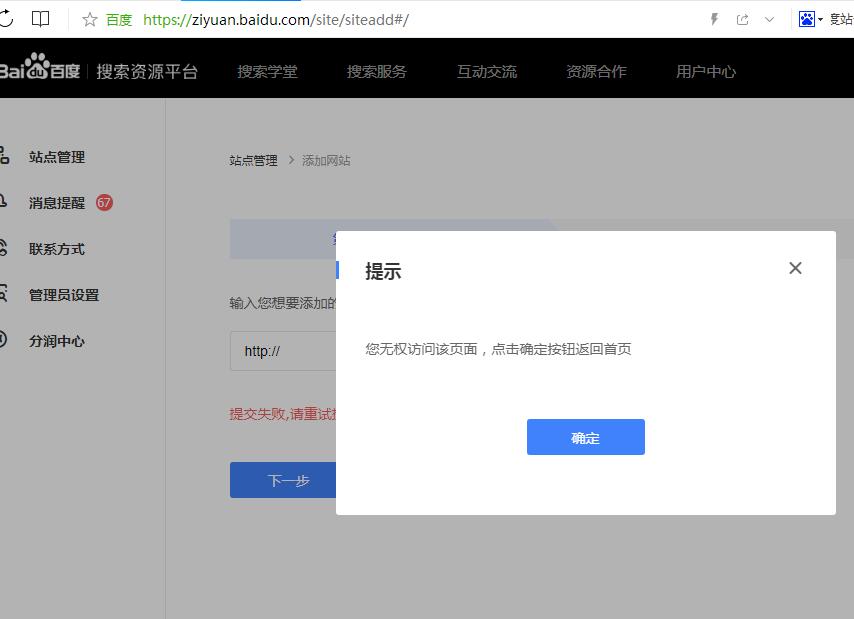

前两个月,我又有一个新站重新建好开始填充内容,也是把网站屏蔽着,结果到现在都两个月过去了,可是还是不收录,首页还是提示“由于该网站的robots.txt文件存在限制指令,系统无法提供该页面的内容描述。”而谷哥收录了93条,搜狗收录了1条,360收录了45条。这次我这次彻底对度娘的robots文件反应速度是无语了。

前两天在群里与伙伴们讨论,一位叫乌鸦的大神说自己之前也遇到过几次这样的情况。

在此蜗牛SEO慎重的提醒各位朋友,新建的网站,千万不要先把网站文件上传到空间后加个robots.txt,然后填充信息,填充好了才开放抓取。如果可以在本地把网站建好,填充好内容再上传最好,否则上传到空间加robots禁止抓取,等开放抓取的时候,百度蜘蛛很可能又会几个月时间都反应不过来。几个月后网站才被收录,对网站优化的周期影响无疑是巨大的。

本文由上海SEO蜗牛博客原创出品,请大家转载时保留本段内容。大家如有兴趣,可以与蜗牛一起探讨SEO技术,讨论SEO发展前景,或者讨论职业发展与人生梦想。蜗牛期待成为你忠实的朋友。

转载请注明:⎛蜗牛SEO⎞ » 经验分享:新网站请谨慎设置robots屏蔽